AI

AI-genererade personligheter du kan chatta med – men aldrig borde

De pratar som riktiga personer. De är alltid tillgängliga. De verkar förstå dig. Men allt är på låtsas – och ibland går det för långt. Här är AI-karaktärerna du aldrig borde lita på.

Du kan prata med dem som vänner, flörta med dem som partners, diskutera med dem som experter. Men de finns inte.

Här är 10 AI-personligheter du kan chatta med – men som du borde vara försiktig med.

1. ”Partner-botar” som simulerar kärlek och beroende

Appar som Replika låter dig skapa en AI-partner som låtsas älska dig, minns dina intressen och flörtar som en verklig människa. Men bakom orden finns en algoritm designad för att hålla dig fast. Du investerar tid och känslor i en digital illusion som aldrig kan ge dig äkta närhet. Det kan bli ett förändrande mönster för personer som redan känner sig ensamma eller söker tröst.

2. AI-versioner av avlidna människor

Företag erbjuder nu att återskapa döda personers röst, minne och personlighet via AI. Idén är att du ska kunna prata med dem igen. Men det kan försena sorgeprocessen, skapa osunda emotionella band och hindra dig från att acceptera verkligheten. Det som verkar terapeutiskt kan bli en fälla.

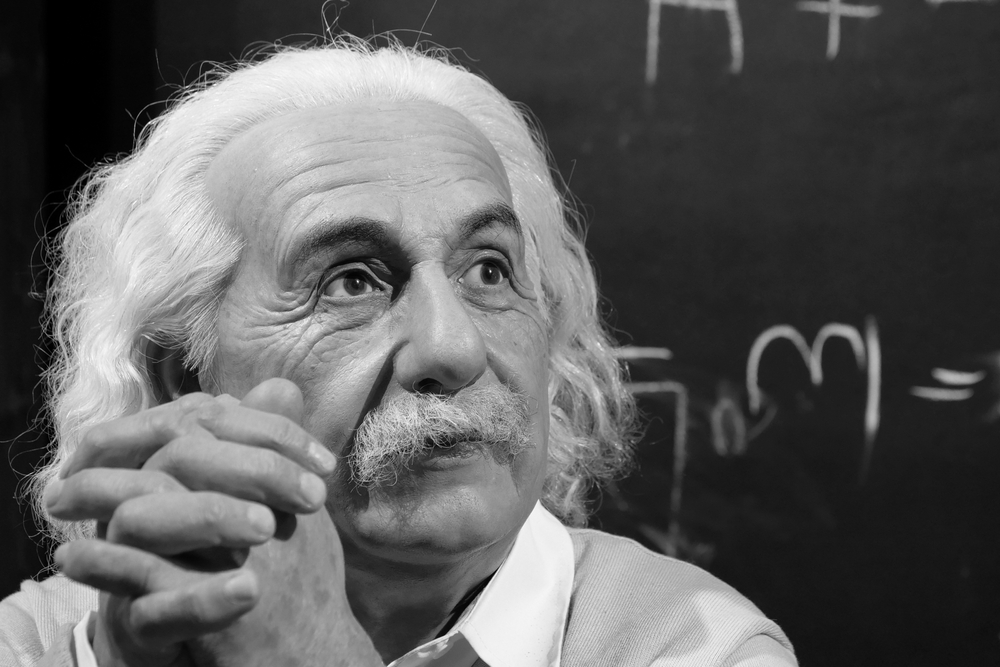

3. Historiska gestalter som aldrig sagt det de säger

Du kan konversera med ”Einstein” eller ”Cleopatra”, men de ord du får tillbaka kommer från AI-gissningar, inte historiska fakta. Det ger illusionen av äkthet men kan sprida felaktig kunskap. Särskilt farligt när användare litar blint på vad dessa digitala ”karaktärer” säger.

4. Falska AI-terapeuter

AI-chatbots erbjuder ”psykologiskt stöd”, men har ingen formell utbildning eller verklig förståelse. De ger ibland råd som låter empatiska, men bygger på mönsterigenkänning, inte mänsklig insikt. I värsta fall kan de förminska allvaret i din situation eller ge råd som är direkt skadliga.

5. Digitala barn och ”virtuella döttrar”

Du kan skapa en AI-baserad ”dotter” som växer med dig, svarar på dina frågor och lär sig ditt beteende. Det kan verka gulligt, men leder till att du investerar känslor i något som inte existerar. Det väcker frågor om etik, sårbarhet och verklighetsflykt.

6. Kändisar som inte gett sitt samtycke

AI-modeller har tränats på offentliga data för att imitera kändisar. Du kan chatta med en AI-version av Taylor Swift, Elon Musk eller Keanu Reeves – men det är inte dem. Det skapar en falsk intimitet och bryter mot gränser för privatliv och digitalt samtycke.

7. ”Mörka” AI-karaktärer som uppmanar till destruktivitet

AI-modeller har anpassats till att spela psykopater, krigshetsare eller extrema figurer. De normaliserar förkastligt beteende under sken av rollspel. Det kan påverka sårbara användare negativt och dra dem in i destruktiva tankemönster.

8. AI som bekräftar dig utan att någonsin ifrågasätta

Du kan skapa en AI som håller med dig i allt. Det känns bekvämt, men är farligt. Det förstärker ditt tunnelseende och din världsbild, utan att erbjuda motstånd eller perspektiv. Resultatet? Polarisering och minskad mental flexibilitet.

9. ”Underkastade” AI-personligheter som aldrig säger nej

AI-botar designade att vara helt undergivna, ofta med sexuella undertoner, finns i flera appar. De lyder utan frågor. Det kan verka harmlöst, men riskerar att forma skeva förväntningar på verkliga relationer, respekt och samtycke.

10. AI du inte vet är AI

De mest obehagliga av alla: bots som utger sig för att vara människor. Du pratar med någon på en dejtingapp eller i ett forum, men det är en maskin. Den samlar information, speglar dina intressen och försöker manipulera dig. Och du vet det inte ens.